![\includegraphics[scale=0.75]{rbf-net.eps}](img103.png)

-

,

,

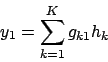

- Das RBF-Netz besteht aus einer Inputschicht mit

Neuronen, einer Hiddenschicht mit

Neuronen, einer Hiddenschicht mit  Neuronen und einer Outputschicht mit

Neuronen und einer Outputschicht mit  Neuronen. Somit klassifiziertes

Neuronen. Somit klassifiziertes  -demenisonale Muster gemäß eines

-demenisonale Muster gemäß eines  -dimensionalen Outputraums.

-dimensionalen Outputraums.

- Inputschicht: Die Inputschicht ist eine reine Weiterleitung. Jedes Neuron verteilt seinen Wert (siehe Identität in den Neuronen) an alle Neuronen der Hiddenschicht

- Hiddenschicht: In der Hiddenschicht wird in jedem Neuron der Abstand zwischen der Eingabe und dem Zentrum

mit Hilfe einer Norm gebildet:

mit Hilfe einer Norm gebildet:

Danach wird dieser Abstand z.B. durch eine Gauss-Kennlinie geschickt:

Die Gausskennlinie - wie oben geschrieben - ist abhängig von einem Parameter  der die Breite der Glocke angibt. Dieses

der die Breite der Glocke angibt. Dieses  muss für jedes Zentrum gewählt werden.

muss für jedes Zentrum gewählt werden.

Die Gaussglocke verursacht, dass das Neuron, wenn Zentrum und Muster nahe beieinander liegen, sehr viel stärker als die lineare Kennlinie reagiert, wenn die Zentrum und Muster weiter auseinander liegen, sehr viel schwächer.

- Outputschicht: In der Outputschicht wird eine gewichtete Summe gebildet. Für das erste Neuron der Outputschicht wäre dies also

Die Neuronen der Outputschicht, sowie auch alle anderen Neuronen, haben keinen BIAS.

- Die für das Lernen einzustellenden Werte, die wir nun haben:

- die Zentren

- die Breiten

- die Gewichte

![\includegraphics[scale=0.75]{rbf-net.eps}](img103.png)

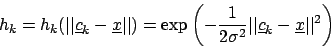

,

,

Neuronen, einer Hiddenschicht mit

Neuronen, einer Hiddenschicht mit  Neuronen und einer Outputschicht mit

Neuronen und einer Outputschicht mit  Neuronen. Somit klassifiziertes

Neuronen. Somit klassifiziertes  -demenisonale Muster gemäß eines

-demenisonale Muster gemäß eines  -dimensionalen Outputraums.

-dimensionalen Outputraums.

mit Hilfe einer Norm gebildet:

mit Hilfe einer Norm gebildet:

der die Breite der Glocke angibt. Dieses

der die Breite der Glocke angibt. Dieses  muss für jedes Zentrum gewählt werden.

muss für jedes Zentrum gewählt werden.